宠粉抽奖-3个要点打开GPU运算加速大门,快来操纵你的GPU!

点击标题下「云轩cloudhin」可快速关注

| 匠心 | 专业 |

Cloud hin,寓意以“云计算助力科技发展”

Cloud hin的品牌目标是“解决计算的问题”,品牌定位是“让专业的计算机装备为无限的计算潜能服务”。

GPU自开放自编程后,其应用范围就越来越广,除了现在最受瞩目的AI应用外,仍有许多领域会需要通过GPU缩短计算时间。不论是科学运算中,解决有限元素分析的求解问题,或是生物工程进行DNA比对,甚至设计师通过软件将完成的CAD模型以光线追踪技术进行加速渲染。由于这些应用使用到大量的数据进行运算,通过GPU硬件及相关以CUDA为基础的算法结合,皆可大幅缩短结果出炉的时间。

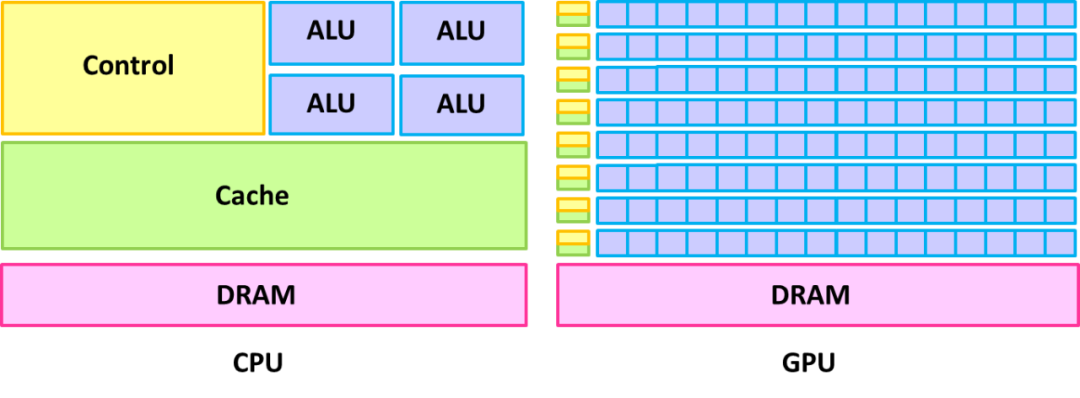

GPU和CPU本质上有很大的不同,CPU具有较大的缓存(cache)和较快的计算核心,可以处理较复杂的运算。

然而GPU不具备这样的条件,缓存较小且单核心计算速度也没有CPU快,只是取而代之的GPU具有大量的计算核心(通称CUDA Core),故其优势在于适合进行同时间的大量运算。一颗顶级的CPU核心数量可达56核心(Intel Xeon Platinum 9282),计算线程(Threads)达112,但低阶的GPU(如Quadro P620)的核心数就有512(GPU的核心数等于计算线程数量)。

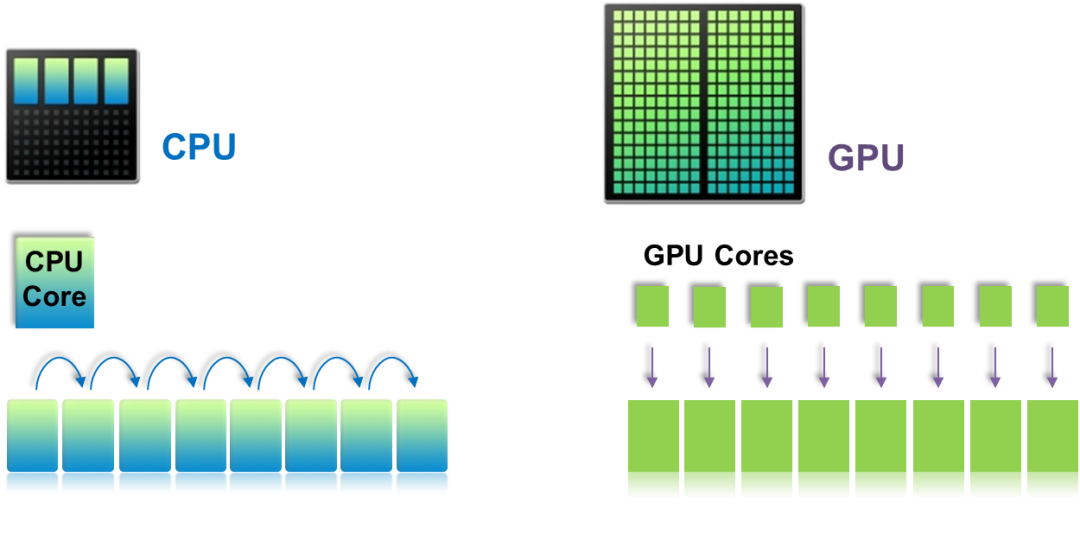

当然这不代表GPU比CPU厉害,而是表示两者适合的计算类型不同。而GPU核心数量多的特点,也需要配合其平行化计算方式,才能将其优点发挥出来,所以由下图可知,GPU在计算时所有核心可高度平行进行计算,而CPU则是以顺序性(sequential)的方式进行计算。GPU是专为图像处理所需的计算密集、高度并行计算设计的。上述应用,都具有计算数据量大且可高度平行化的特性,也就最适合使用GPU来计算。

▲CPU和GPU设计架构及计算特性

第一项种类繁多,其中又以有限元素分析领域最多,此领域相关计算包含流体力学分析、热传导分析、电磁场分析或应力分析等等应用。由于范围涵盖IC设计、建筑设计、甚至许多交通工具或化工厂也需通过这类软件进行仿真分析,故开发这类软件有很大的商业价值。

NVIDIA官方常见的如矩阵计算函数库cuBLAS、频率分析函数库cuFFT、深度学习函数库cuDNN等等,但也可从如GitHub社群上搜寻。上述两项也可参考NVIDIA官方收录的「GPU-ACCELERATED APPLICATIONS」,内容已将各领域可使用GPU的软件或套件收录并提供简介,让开发者可容易找到合适的应用套件。

第三项就必须通过程序语言进行CUDA撰写,不过依照程序语言不同,能够操控的自由度也不相同,其中较底层的程序语言C/C++或Fortran属于自由度最高的程序语言,可利用程序语言控制GPU计算,甚至可针对本机内存与GPU内存数据传输进行优化。其次则为Python,Python也是现今最主流进行人工智能应用开发的程序语言。实现的方式包含PyCuda或是使用Numba函数库,PyCuda的使用者还是需要在核心程序撰写CUDA C,当然其效能几乎也等同于撰写CUDA C的效能,而Numba则是通过装饰器(decorator)于函数声明,并使用函数签名(function signature)完成呼叫CUDA的设定。此外,Java、R、C#等也都可以支持CUDA,但都不如C/C++或Fortran直接。

NVIDIA合作伙伴—Cloudhin®云轩

专业为AI、数据科学和科学计算加速

众所周知,Nvidia的GPU当下不仅是云端人工智能加速的主流解决方案,其CUDA生态更具有完整编程和工具链,正因此,现在主流的深度学习框架基本都是基于CUDA进行GPU并行加速。目前GPU深度学习服务器在AI,视频处理,科学计算等领域都有广泛应用,如何配置一台属于自己的GPU服务器可谓重中之重。

Cloudhin®云轩专注Deep learning和高性能计算服务器定制,针对主要深度学习框架(如TensorFlow、Caffe 2、Theano或Torch)进行了优化和设置,在桌面上即可提供强大的深度学习功能。

购买深度学习主机,即可获赠2T硬盘*1+罗技键鼠套装!

1.扫描下方小程序码,直达抽奖页面

2.本次活动随机抽取75人,8月5日20:00自动开奖

WS4128深度学习工作站搭载10代Intel Core i9-10900K不锁频处理器,单核最高频率可达5.3GHz。可选双路Nvidia Titan RTX GPU,革命性的全新Turing架构,给您的PC配备260 Tensor TFLOPs的性能、1152个Tensor核心,以及48GB的高速GDDR6显存 。强芯算力释放GPU加速人工智能和深度学习的强大功能,帮助AI开发者和数据科学家更快捷地取得成果。

专业勤修,锐意进取。云轩技术工程师毕业于NVIDIA深度学习研究所,丰富经验,值得信赖。更多定制方案请联系客服,我们将实时响应您的定制需求。